Как найти и обезвредить дубли страниц Replytocom

Приветствую Вас, уважаемые читатели!

Сегодня я расскажу о том, что за страшный зверь дубли страниц replytocom, как проверить свой сайт на replytocom и как удалить дубли страниц?

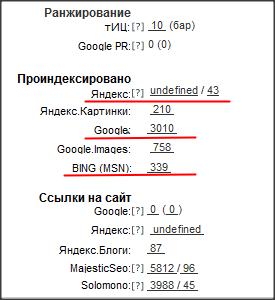

Вы, наверное, подумали, что я начал играть в компьютерную игру или начитался книг в стиле фэнтези или фантастики и там нашел такой термин? Нет, все намного проще. После очередного анализа своего блога при помощи программы Site Auditor я обнаружил, что Яндекс индексирует 43 страницы, а Google 3010(!). Я начал изучать материал по данной теме и узнал, что такое дубли страниц и насколько это вредно?

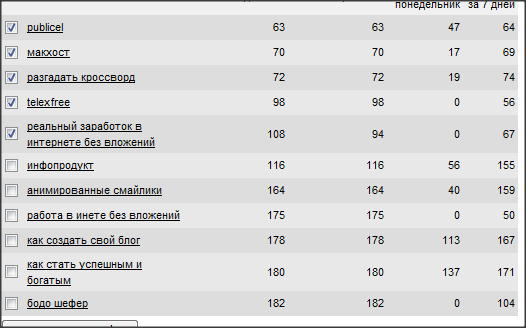

Также в последнее время заметил, что по поисковым запросам Google стал относится ко мне принебрежительно. Если месяц назад картина была такой:

То сейчас все намного хуже:

Итак, мне стало интерсно, что происходит?

Как обнаружить дулированный контент replytocom?

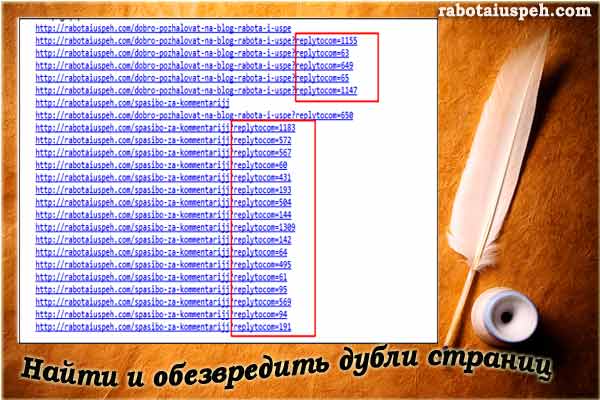

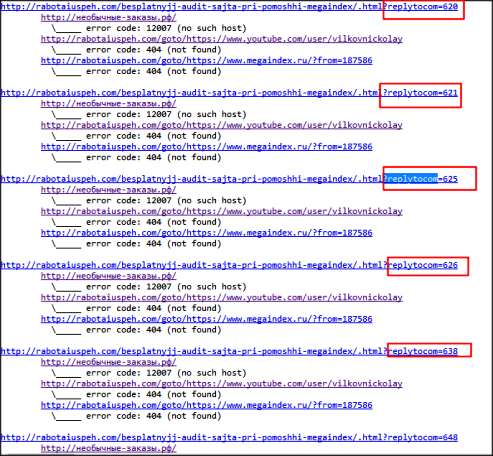

Когда я установил бесплатную программу Xenu Link Sleuth и провел анализ своего блога, то обнаружил огромное количество ссылок на страницы, в конце которых значилось l?replytocom=454.

Их было очень много, учитывая, что на моем блоге всего 70 записей, а цифра проиндексированных страниц 3010! После этого я выяснил, что же такое replytocom.

Движок Вордпресс довольно хорош, но одним из его недостатков является то, что при использовании древовидных комментариев, создаются дубли страниц. А древовидные комментарии установлены у всех по умолчанию, хотя в платных шаблонах может и по другому.

Под каждым комментарием есть кнопка “Ответить”, если на него навести, то слева внизу вы сможете увидеть адрес . Это означает, что при ответе, создается новая страница, дублирующая предыдущую, с таким же адресом и добавлением http//:…Replytocom=1402#respondent.

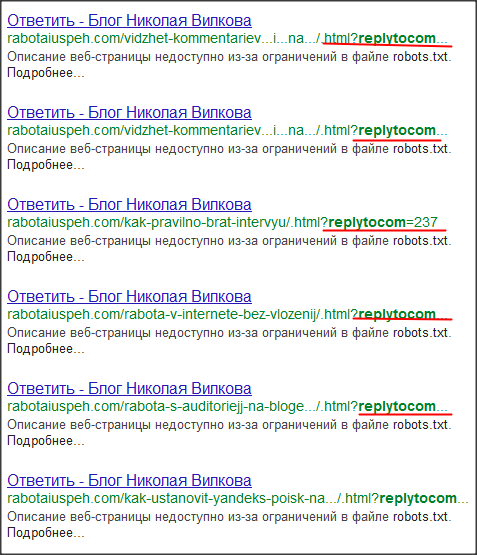

Проведите маленький эксперимент: откройте поисковик Google и вбейте в строку поиска site: вашсайт.ру replytocom, где вместо вашсайт.ру вставьте адрес вашего блога.

Вот какая картина была у меня

Из этого видно, что надо как то менять картину и удалять дубли страниц с Replytocom.

Как удалить дубли страниц Replytocom

-

Отключаем древовидные комментарии

Заходим в админку » Настройки» Обсуждения и убираем галочку “включить древовидные комментарии” и обязательно опускаемcя вниз и жмем “Сохранить”

Не переживайте за старые комментарии, они все останутся, только будут расположены в столбик.

Согласен, что древовидные комментарии очень удобны, без них будет не весьма удобно для читателей сайта. Один из путей реализации — можно установить плагин WordPress Thread Comment, который установлен на моем блоге. После установки этого плагина дубли replytocom образовываться больше не будут.

После отключения дубли создаваться не будут, но нам нужно убрать от индексации уже созданные, для этого идем далее.

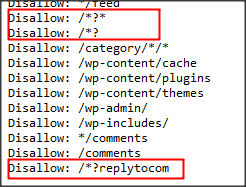

2. Вносим изменения в файл robots.txt

Поскольку файл robots.txt является лишь рекомендацией для поисковых роботов, то его изменение не гарантирует изменение в индексации роботом Google, тем не менее, я УДАЛИЛ следующие строки из файла robots.txt:

Disallow: /*?replytocom

Disallow: /*?*

Disallow: /*?

После этого, за 2 месяца количество проиндексированных страниц уменьшилось:

11 ноября их 3010

11 января их 2010

Это все равно не мало, но прогресс на лицо, буду ждать полной очистки от дублей.

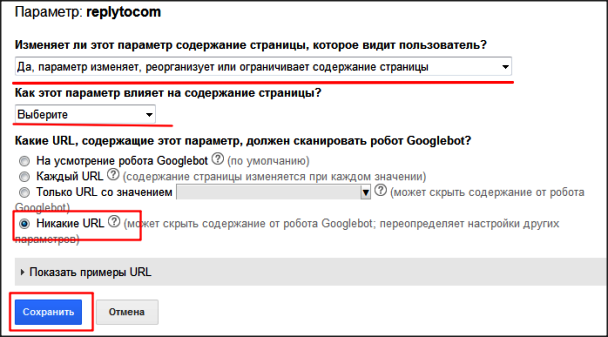

3. Удаление replytocom через “Инструменты для веб-мастеров Google”

Для этого Вам необходимо зайти в Google вебмастер (если вы зарегистрированы), выбираете свой сайт и далее “Сканирование”=> “Параметры URL”. После этого добавляем новый параметр replytocom, как показано на рисунке ниже:

Далее сохраняем. Можно выбрать выариант «На усмотрение поисковых роботов».

Теперь мне остается подождать несколько дней или недель и снова проверить блог на дубли страниц и изменения в индексации страниц поисковиками google.

4. Делаем редирект в файле .htacces

Этот пункт является не обязательным, но всё же, для подстраховки можно добавить эти пару строк в свой файл .htacces.

Данный файл .htacces находится в корневой папке вашего блога, если его нет, можно создать и добавить туда эти строки:

RewriteCond %{QUERY_STRING} replytocom=

RewriteRule ^(.*)$ /$1? [R=301,L]

Это позволит переадресовать читателя, который попал на страницу с replytocom на основную заметку.

Вот основные шаги, которые помогут вамнаучиться находить и научится дубли страниц replytocom на своем блоге на движке WordPress.

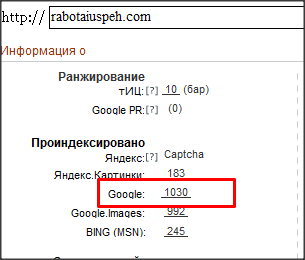

5. Прошло семь месяцев, избавился ли я от дублей ?

Вот такая картина теперь у меня с индексацией страниц:

Как видите, из 3010 страниц, которые были 11 ноября 2013 года в индексе Google, осталось 1030. От дублей, которые вызваны древовидными комментариями я избавился полностью, вот доказательство:

Я набрал в поисковике Google :

site:rabotaiuspeh.com replytocom

Обнаружил там всего 10 постов, в которых упоминались слова «дубли» и «replytocom», но дублей, которые вызваны были ранее древовидными комментариями уже нет. Это, конечно же, прогресс, но всё равно, дубли есть. Как это есть, спросите вы? Да, есть, но это уже совсем другие дубли, про которые я расскажу в заметке про дубли страниц.

Напишите, пожалуйста, что вы думаете об этом. Сталкивались ли вы с подобными проблемами и насколько быстро эти дубли исключались из индексации Гуглом?

Вот все, о чем хотел сегодня рассказать, уважаемые.

До встречи!

Интересные статьи по данной теме:

Необычные и смешные поисковые запросы читателей блога

Как ускорить индексацию сайта в Яндекс и Google

Что такое траст сайта? Как увеличить доверие поисковых систем?

С уважением, Вилков Николай

Хотите в числе первых узнавать о новых статьях и курсах?

Подпишитесь на обновления моего блога и мой канал на YouTube

Если статья вам понравилась, поделитесь с друзьями в социальных сетях. Спасибо!

Помоему у вас картинки с посещаемостью «как было» и «как стало» перепутаны 🙂

А так спасибо за статью!

Юрий, с картинками все верно. На них отображается не посещаемость, а по каким запросам в Google я находился и сейчас нахожусь на каком месте. Чем ближе место к 1 ому, тем лучше. Раньше по нескольким запросам в Google я был в 20-ке, а теперь только в 7 десятке и количество запросов резко упало. 😛

На моем шаблоне стоит плагин для древовидных комментариев, поэтому о такой проблеме не слышал.

Скажу только, что надо бороться со всеми ненужными страницами в индексе — от этого блог определенно станет лучше ранжироваться (увеличивается уникальность контента на странице).

теперь все понятно:)

Ого, никогда бы не догадалась проверить блог на дубли страниц. Спасибо, Николай. Пойду погляжу сейчас тоже, надеюсь у меня такой проблемы нет.

Юрий, это хорошо, что разобрались

Диана, ну как проверка? Ты мне просто цифры черкни, сколько Яндекс индексирует страниц, а сколько Google и все станет понятно. 😀

Ну я думаю, что строчки в robots.txt будет достаточно. В роботсе нужно вообще прописать всех страниц, где знак вопроса встречается )))

В роботсе нужно вообще прописать всех страниц, где знак вопроса встречается )))

Антон, такая строка в robots.txt у меня была и тем не менее Google эти записи игнорирует, у Яндекса с этим все хорошо.

Много информации, сразу все не пойму. У меня Яндекс писал, что с вопросительным знаком что-то не так и я его из роботс убрала. Комментарии древовидные, но страниц всего 49 индексирует. Нужно будет уделить время, разобраться. Может не в этом проблема?

Натала, если всего 49 индексирует, значит у Вас не та проблема, о которой я писал. У меня наоборот, при 70 статьях Гугл видит 3020 записей и применяет санкции ко мне

Нужно и мне просмотреть, а нет ли у меня каких то дубликатов на сайте.

Спасибо за хорошее разъяснение.

Виктор, это нужно делать, если сильно ранятся показатели проиндексированных страниц в Яндексе и Google

Ага, несколько дней! Вашим методом не избавиться от соплей, они все равно будут висеть в индексе, с единственной разницей, в снипете будет написано «Описание веб-страницы недоступно из-за ограничений в файле robots.txt.»

Чтобы окончательно избавиться нужно делать редирект в файле .htaccess и открывать в robots.txt при чем полностью:

Disallow: /*?replytocom

Disallow: /*?*

Disallow: /*?

вот это все убирать, тогда будет результат и то через несколько месяцев в Гугле, в Яшке через 2-3 недели.

Ваш метод бесполезен, проверял на 2 сайтах пару лет назад, ждал пол года, результаты минимальны 30-40 страниц.

Сергей, приветствую на блоге!

Спасибо за совет, я в файл .htacces внес корректировку

RewriteCond %{QUERY_STRING} replytocom=

RewriteRule ^(.*)$ /$1? [R=301,L]

между тэгами IfModule

Древовидные комментарии я сразу отключил.

В гугле за 4 дня 40 страниц только уменьшилось.

Думаете, если убрать из robots.txt три эти строчки, то будет лучше, вы проверяли?

Забыл сказать: Либо полностью запретить древовидные комментарии.

За статью спасибо, почитал с интересом.

Жаль, что из-за дублей приходится удалять древовидные комментарии и если я правильно поняла из комментариев, плагин таких проблем создавать не будет. Вообще, о дублях страниц много слышала, но подробностей о том, где искать и как избавляться не знала. Так что, Николай, большое спасибо за ценную информацию.

Анна, пожалуйста. Я понимаю, что древовидные комментарии удобны, я их верну но немного по-другому, не плагином.

replytocom это собственно часть url’а кнопочки «Ответить» под каждым комментарием. Соответственно страничек таких будет столько же сколько комментариев у вас в блоге. Да, эта кнопка появляется когда включаешь древовидные комментарии.Но ноги растут из robots.txt.

У меня изначально было закрыто в robots.txt по сему гугля хоть и видит их но не показывает в поисковой выдаче.

Pixel, у меня также все закрыто в robots.txt, тем не менее это для Google не указ, а всего лишь рекомендации, которые он игнорирует.

Такая проблема у меня тоже есть. Повторов в 10 раз больше чем статей. Но у меня на этом блоге всего два комментария. Причина — сложная форма комментирования, с регистрацией, и я ее не могу изменить, такие условия.

Попробую сделать корректировки в Гугл Веб мастере, по вашей рекомендации.

У меня Гугл постепенно меняет отношение по выдаче блоге по определенным запросам.

Медленно, но индексация улучшается. Но, как выражаются СЕО-шники, «сопли», созданные древовидными комментариями еще болтаются и непонятно, уйдут ли совсем. 😆

Николай Вилков.

Здравствуйте Николай. Извините за долгий ответ. Нужно обязательно убрать все ? в robots.txt , робот должен зайти на эти страница и увидеть редирект 301, тогда сразу увидите результат, у меня было страниц проиндексировано 1500 , за два с половиной месяца осталось 570 и процесс продолжается, я рад. Основной индекс вырос в процентах и трафик с гугла подрос(хотя не знаю с этим это связано или нет). А с яшей проблем вообще нет(тьфу, тьфу), за две недели все выкинул, остались только станицы и посты.

Спасибо, Сергей, попробую убрать с robots.txt эти строки. Позже напишу результат.

Интересная статья, у меня тоже дубли, но я упорно жду, когда они сами уйдут из поиска. Напишите, как обстаят сейчас у вас дела с дублями.

Зоя, приветствую Вас!

Перед Вашим комментарием провел анализ и вижу 61 страницу в Яндексе и 2100 страниц в Гугле, а было 3010 в Гугле на 11 ноября.

Почти тысяча дублей ушла за 2 месяца, вот такие темпы, думаю не плохо. Читал у других вебмастеров также по полгода дубли уходили или как их называют «сопли», пардон 🙂

А обязательно закрывать от древовидных комментариев? если у меня роботс по максимуму все закрывает…я новый установила, в принципе из за нового роботса и стали дубли вылетать..у меня за 20 дней вылетело 650 страниц. действительно долго вылетают

а если у меня в роботсе нет replytocom,надо ли добавлять url в гугле?

И еще! у меня было не много дублей комментариев, они исчезли со временем, а остальные дубли от куда могут быть, у меня их стала еще на 800 больше.

Зоя, я писал в статье только про дубли страниц replytocom, вызванные древовидными комментариями. Чтобы узнать, от чего у Вас появилось много новых дублей необходимо сделать анализ сайта и тогда делать вывод. Просто так я не могу ничего сказать без анализа и конкретных цифр.

Зоя, простите, но я не понял ваш вопрос…

Вы имеете ввиду при удалении страницы в Гугл добавлять url?

А вы, не глянете мой сайт ,если не тяжело. Дубли у меня вышли из поиска, которые были вызваны древовидными комментариями, а остальные нет, их вообще приличное количество.

Зоя, я вам отправил письмо на почту, указанную у вас, а также прочтите этот пост

там по вашей теме как раз.

Здравствуйте! Я убрала галочку в настройках «древовидные комментарии», дублей страниц нет, вызванных древовидными комментариями. Мне теперь заново галочку поставить? и в роботсе оставить строки Disallow: /*?*

Disallow: /*? И еще вопрос, эти дубли же постоянно будут появляться или как?

Да, дубли в Google будут появляться и их нужно запрещать к индексации в robots.txt панели вебмастеров Google

Зоя файл robots.txt на любом блоге доступен по адресу- сайт.ru/robots.txt

Я свой файл опубликовал, посмотрите, что там есть, а чего нет.

По-моему, вы слишком фанатично ищите ответы на вопросы, которые совершенно не важны. Не зацикливайтесь на этом файле, а то я уже начинаю сомневаться во всем на свете после ваших вопросов.

Напишите стандартный robots.txt и понаблюдайте месяц-два… Если будут проблемы, тогда ищите пути их решения.

Николай аналиогично не работает! У вас 1200 дублей в индексе гугла, пусть даже не основном, но он цапает эти страницы.

Сейчас вижу вы убрали функцию ответов на комментарии. Уже упало количество дублей?

Александр, привет! Христос Воскресе!

Было 3100 страниц в Гугле 11 ноября, вот сейчас 1280 страниц в Гугле по состоянию на 20 апреля, потихоньку вылетают, но так медленно…

Древовидные комментарии я убрал сразу, без них можно обойтись, хотя и не очень комфортно читателям.

Вот почему только с Гуглом такие проблемы с дублями….

Я удалил в robots.txt строки:

Disallow: /*?replytocom

Disallow: /*?*

И добавил в файл.htacces

RewriteCond %{QUERY_STRING} replytocom=

RewriteRule ^(.*)$ /$1? [R=301,L]

между тэгами IfModule

Disallow: /*?

После вылета всех лишних страниц из индекса, подкорректирую robots.txt снова

Николай, это тоже не помогает. Пробовал.

В общем есть 2 фишки как от них избавиться.

1. Посмотрите уже реализовано на моем блоге. При нажатии на кнопку «ответить» в комментарии вы не увидите ссылку в трее вида replytocom, там просто #respond и все.

То есть можно в одном месте подправить код и все. Новых дублей больше не будет. А вот старые еще есть и их надо убирать. Ну они сами вылетят со временем.

2. Это поставить плагин WordPress Thread Comment. Он выводит комменты яваскриптом. Так сделано у Сани Бобрина. У него нет дублей.

Вот по-тихоньку жизнь налаживается. =)

Саша, спасибо за ценные советы, очень признателен.

Постараюсь реализовать в ближайшее время.

А у меня опять полная неразбериха с дублями, поменяла рорботс 2 месяца назад. было 4100 дублей- за 2 месяца уменьшилось до 3280, а сегодня смотрю — за сутки подскачили на 540 дублей. такое разве может быть?

Пожалуйста Николай. Как я понял вы вообще убрали деревяшки. если что могу помочь, будут работать как надо!

Александр, простите, я не понял, что за «деревяшки»? Если Вы имеете в виду дубли страниц, сегодня установлю плагин, который вы порекомендовали.

Деревовидные комментарии. replytocom. Вы их убрали?

Ааа, вот почему «деревяшки», я их отключил еще в ноябре, как только увидел такое огромное количество дублей страниц. Вот сегодня плагин установлю и проанализирую, не возникает ли новых дублей в Google.

Отключить деревяшки, это самые простой и эффективный вариант конечно же. Но старые дубли остались. Кстати у вас url неправильно отображается — /.html

Про url знаю, спрашивал у Сергея Сосновского про эту проблему, он дал советы, но для меня их не так легко реализовать технически. Считаю, что это не очень страшно, лишний слеш в URL страниц.

ну, как сказать 🙂 не красиво чтоли ) но даже не в красоте дело. Я бы побаивался этого 🙂 По этому поводу ответил в почту.

Можно ли опубликовывать статьи если есть дубли, или же пока они не уйдут, статьи не нужно на сайт опубликовывать? просьба ответить

Зоя, наоборот, вы должны с удвоенной энергией продолжать писать полезные и уникальные статьи и правильно их рекламировать в соцсетях и на различных сервисах. Главное, это отключить древовидные комментариии на блоге, убедиться, что новые дубли не образуются и продолжать развитие блога. Дубли постепенно будут вылетать из индекса, со временем всё нормализуется. Кстати, я недавно писал, как реализовать древовидные комментарии на блоге так, что дубли не будут образовываться .

Николай, я сейчас собираю информацию про то, как удалить дубли страниц. До этого отключала древовидые комментарии, но читателям было не удобно и я теперь ищу простую и действенную практическую методику.

У меня вопрос. Вы пишите, что:

«Делаем редирект в файле .htacces

Этот пункт является не обязательным, но всё же, для подстраховки можно добавить эти пару строк в свой файл .htacces.»

То есть можно не выполнять этот пункт?

Я такой редирект делал, но через пару дней убрал, поскольку мне файл .htacces программист менял полностью по другим причинам. Со временем replytocom уйдут и переадресация будет не нужна.

Я древовидные комментарии вывел плагином WordPress Thread Comment, он не создает дубли, выводит ответы при помощи jawa

Программа Xenu Link Sleuth давненько установлена.

Тут натолкнулся на эту статью и решил проверить на дубли.

Я в шоке,срочно нужно убирать 😯

Здравствуйте!!!! поменяла роботс, по вашей статье, 7 месяцев не было публикаций вообще- дубли ушли от 3500 до 300, начала заново пополнять статьями, и тут дубли опять растут, в чем может быть дело? 😀 😳

Это хороший результат, Зоя, такое уменьшение. Дело может быть шаблоне, смотря какие дубли у вас плодятся, если вызванные комментариями, то необходимо в настройках отключить древовидные комментарии.